NEWS

新闻文章

从“听得见”到“看得清”:基于NLP大模型的消

时间: 2026-03-17 10:03 作者: 欧尼达

点击:

次

2023年某日凌晨,某市一栋老旧居民楼突发火灾。报警电话接通的那一刻,指挥中心大屏上呈现的不再仅仅是跳动的波形和定位红点:

•报警人颤抖的声音被实时转写成文字,关键信息自动高亮

• 系统自动向报警人手机发送视频邀请链接,30秒后,现场画面传回——浓烟正从三楼窗户涌出,楼下已有人群聚集

• GIS地图上,最近的消防站、沿途实时路况、周边水源分布同步呈现

• 更关键的是,系统根据现场烟雾浓度和建筑结构,自动研判火势蔓延趋势,向指挥长推荐了“内攻+外部举高”的作战方案

这是多模态融合指挥的一个缩影。从单一语音通道,到语音、视频、数据、GIS的“多模态融合”,119指挥中心正在经历一场从“听得见”到“看得清”的范式跃迁。

一、为什么必须走向多模态?

1.1 传统语音接警的“信息黑洞”

火灾现场,报警人往往处于极度恐慌状态。研究表明,人在恐慌时:

•语言表达能力下降40%以上

•对关键信息的记忆和表述容易出现偏差

•无法准确描述火势规模、蔓延方向、建筑结构等专业信息

这就造成了典型的“信息黑洞”:接警员听到的只是碎片化的、可能失真的描述,却要在信息严重不足的情况下做出派警决策。

1.2 多模态指挥的核心价值

多模态融合的本质,是通过多种信息渠道相互印证、补充,还原现场真实状态:

| 信息维度 | 传统方式 | 多模态方式 | 价值增量 |

| 位置 | 报警人口述 | 手机GPS定位+基站定位 | 精度从几百米提升到10米 |

| 现场情况 | 口述描述 | 视频画面直传 | 直观判断火势、被困者位置 |

| 环境数据 | 无 | 周边物联网传感器(烟感、温感) | 量化火势发展趋势 |

| 资源状态 | 人工查询 | 实时GIS图层 | 动态最优路径规划 |

二、多模态融合指挥的技术实现

2.1 视频能力:从“听声音”到“看现场”

视频融合的关键技术包括:

视频回传通道:系统通过短信或微信小程序向报警人手机发送视频邀请链接,无需安装App即可接入。H.265编码技术在保证画质的同时,将带宽占用降低40%,即使在4G信号不稳定的区域也能流畅传输。

视频结构化:接收到的视频流经AI分析,自动识别:

烟雾颜色、浓度、扩散方向

火焰高度、燃烧范围

被困人员位置、姿态

周边环境(如是否有易燃物堆积)

2.2 GIS融合:从“点定位”到“面感知”

传统119系统只能展示报警点位置。多模态融合下,GIS图层叠加以下信息:

实时路况:自动避开拥堵路段,计算最优到达路径

水源分布:周边消防栓位置、可用状态、水压信息

建筑信息:接入城市CIM平台,调取建筑结构图、消防设施分布

力量分布:附近其他消防站、社会救援力量实时位置

2.3 NLP大模型:多模态信息的“融合中枢”

多模态信息不是简单堆砌,而是需要“理解”和“关联”。这正是NLP大模型的价值所在:

技术原理:

多模态输入 → 大模型融合处理 → 决策建议输出

├── 语音流(ASR转写)

├── 视频流(视频结构化)

├── GIS数据

└── 历史案例库

典型应用:

1. 情绪识别与干预:大模型分析语音的语速、音调、停顿特征,结合视频中报警人的表情、动作,综合判断其心理状态。当检测到极度恐慌时,系统自动在接警员屏幕上推送安抚话术建议。

2. 现场要素自动提取:大模型融合语音转写内容(“煤气罐爆炸了”)和视频分析结果(画面中出现气罐残骸),自动确认“危化品风险”标签,并推送相应处置预案。

3. 指挥决策辅助:综合火势发展速度、被困人员位置、周边资源,大模型实时推演多套作战方案的预期效果(如“方案A:内攻救人,预计耗时8分钟,风险等级中;方案B:外部控火,预计耗时15分钟,风险等级低”),供指挥长参考。

三、从“看得清”到“看得懂”:大模型带来的质变

如果说多模态融合解决了“看得清”的问题,那么大模型则实现了“看得懂”。

3.1 历史案例的实时匹配

大模型将当前警情与历史案例库进行语义级匹配。当报警人描述“楼道堆满电动车,现在起火了”,系统自动检索出最近三年本地类似案例的处理过程和结果,为指挥决策提供参考。

3.2 应急预案的动态生成

传统预案是静态文档。大模型根据现场实时信息,动态生成适配的作战方案,并根据事态发展自动更新。例如,当视频分析发现火势向毗邻仓库蔓延时,系统自动调整派警方案,增加大功率水罐车。

3.3 知识沉淀与培训赋能

每次接警处置过程,都被大模型自动结构化,形成新的训练样本。新入职接警员可通过系统学习历史案例,加速经验积累。

四、实现路径:中间件模式让多模态指挥快速落地

对于已建成的119指挥中心,实现上述功能是否需要推倒重来?答案是否定的。

4.1 技术挑战

多模态指挥涉及的技术栈极为复杂:

视频能力:需支持多协议接入、实时转码、AI分析

大模型:需对接多家厂商的通用大模型或行业垂类模型

数据融合:需打通GIS、CIM、物联网等多个外部系统

并发处理:需支撑视频流、语音流、数据流的高并发融合计算

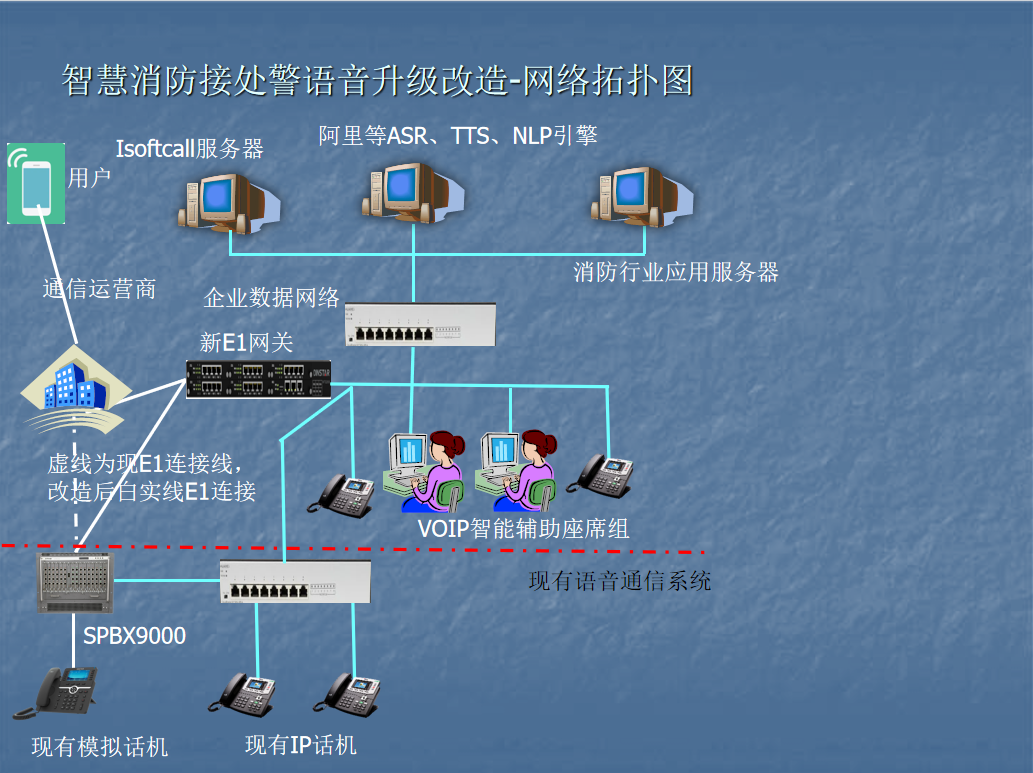

4.2 iSoftCall的解决思路

iSoftCall智能AI呼叫中心中间件在多模态指挥场景中扮演“融合中枢”角色:

接入层:

通过SIP协议对接现有交换机,获取语音流

通过标准API对接视频平台,获取视频流

通过数据接口对接GIS、CIM、物联网平台

处理层:

内置ASR引擎对接,实时转写语音

内置视频AI分析模块,结构化处理视频流

集成大模型接口,调用通用或行业大模型能力

多模态数据融合处理,生成统一事件模型

输出层:

通过标准API向业务系统推送融合后的结果

支持实时弹屏、辅助决策面板、指挥大屏等多种呈现方式

4.3 部署优势

模块化集成:可根据客户预算和需求,分阶段引入视频能力、大模型能力

厂商中立:支持对接讯飞、百度、阿里、华为等多家AI厂商,避免锁定

并发保障:在多模态处理全程开启的情况下,仍能支撑高并发请求

在四川、攀枝花等地的119智能热线项目中,这一理念已初步落地。当报警电话响起的那一刻,坐席看到的不仅是一张地图和一个电话号码,而是一个正在实时生长的“数字孪生现场”。

而这,正是从“听得见”到“看得清”,再到“看得懂”的完整跃迁。

- 呼叫中心系统如何搭建?从零到一的实战指南(

- AI人工智能呼叫中心产品选型指南:2026集成商必

- 消防应急调度智能化:快速响应,减少灾害损失

- 全球视频客服市场发展现状与前景展望

- 基于中间件的气象应急响应系统设计与实现

- SaaS系统相比传统系统的优势

- 快递虚拟电话取件语音通知的实现方法

- 呼叫中心系统包括哪些?

- 呼叫中心系统解决方案

- 如何利用云电话中间件快速搭建云呼叫中心系统

- IVR导航与智能语音导航的区别及替代方案

- 呼叫中心系统电话通话录音方式及升级方案

- 人社客服系统智能升级的方式

- 于本地板卡和交换机的桶装水配送系统改造

- 智能呼叫中心中的人工智能技术有哪些?

- 企业如何通过AI客服系统提升响应速度

- 了解企业AI客服系统的发展历程和技术特点

- 如何选择合适的电话呼叫中心服务?